Mucho se ha hablado de las atrocidades que podrían hacerse realidad de manos de la inteligencia artificial en un futuro cercano. Inclusive, Elon Musk, junto a otros «detractores» de la IA, han propuesto hace poco una moratoria para el desarrollo de este tipo de sistemas.

El futuro pinta de forma apocalíptica para algunos, quienes han planteado escenarios catastróficos en los que la IA termina volviéndose contra los seres humanos y aniquilando la raza humana.

También ha sido claro el efecto nocivo que las inteligencias artificiales pueden tener para la fuerza laboral y la economía en general. Muchos puestos de trabajo que desaparecen de golpe, implicarían precariedad para gran parte de la población. Adelantándose a este futuro hay quienes proponen una renta básica universal para paliar el problema.

Creemos que, aunque no podamos saber si un panorama al estilo Terminator pueda ser posible, a día de hoy existen problemas ya tangibles que la IA está ocasionando y de los cuales debemos tener cuidado, inclusos si estos no terminan en la extinción de la raza humana.

1 Sesgo

GPT se entrena en grandes cantidades de datos de texto, lo que significa que puede aprender y replicar sesgos culturales, de género, raciales y otros prejuicios que se encuentran en los datos de entrenamiento.

Incluso en estos momentos, ChatGPT puede ser bastante restringido al momento de expresarse, por lo que a algunos les ha parecido bastante «Woke»

2 Respuestas inapropiadas

Debido a la naturaleza generativa de GPT, puede generar respuestas inapropiadas o incluso ofensivas si no se controla adecuadamente el conjunto de datos de entrenamiento. Tal es el caso de la obra de Vermeer, «La joven de la perla» y sus resultados erróneos en el buscador de Google.

3 Falta de contexto

GPT puede tener dificultades para comprender el contexto y el significado detrás de las palabras y frases, lo que puede llevar a respuestas inexactas o irrelevantes.

Las inteligencias artificiales son sistemas diseñados para procesar grandes cantidades de datos y tomar decisiones basadas en patrones y algoritmos. Sin embargo, una de las principales limitaciones de las IA es la falta de contexto.

La falta de contexto se refiere a la incapacidad de las IA para comprender el significado detrás de los datos que procesan. Por ejemplo, una IA puede identificar correctamente una imagen de un perro, pero no entenderá el contexto detrás de la imagen, como el hecho de que el perro está jugando con un niño en un parque.

4 Dependencia de datos

GPT requiere grandes cantidades de datos de entrenamiento para funcionar correctamente, lo que puede ser costoso y llevar mucho tiempo recopilar y etiquetar.

5 Dificultad para personalizar las respuestas y las altas probabilidades de plagio

Puede ser difícil personalizar sistemas como GPT o semejantes para adaptarse a las necesidades específicas de un negocio o industria. Por lo que los textos genéricos están a la orden del día cuando se trata de las respuestas de ChatGPT o similares.

Para evitar esto, siempre se recomienda el uso de Promts personalizados que permitan generar contenido adecuado y poder destacarse en Internet con información original y relevante. Además, el conocimiento especializado para cualquier área debe respaldar siempre al contenido generado por estas IA.

Otro de los problemas en este apartado es el plagio. Estos sistemas generan contenido sin citar fuentes y muchas veces generan información que se han sacado completamente de la manga (una obsesión extraña por cumplir con lo que se le pide).

6 Falta de transparencia

Debido a la complejidad del modelo, puede ser difícil entender cómo GPT llega a sus respuestas, lo que puede dificultar la solución de problemas y la identificación de errores. Esto es especialmente cierto para aquellos menos familiarizados con la tecnología.

Sistemas de IA como ChatGPT pueden tener para algunos ese efecto de «caja mágica/negra» a la que puedes pedirle cualquier tipo de deseo, sin necesidad de saber nada más que cómo indicarle aquello que deseas.

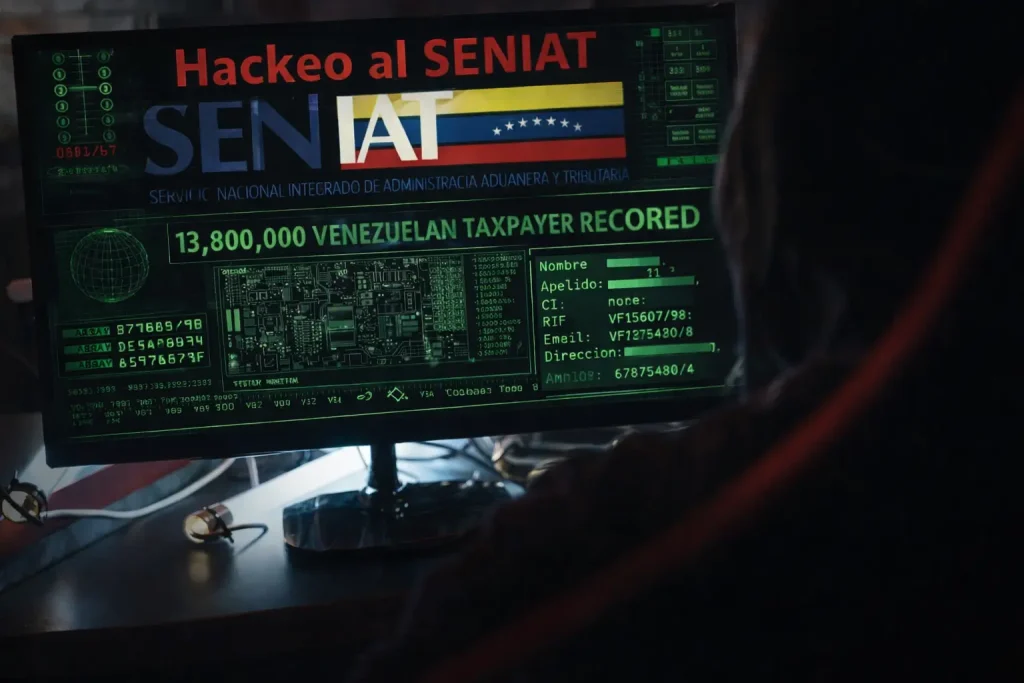

7 Riesgo de seguridad

Si se utiliza incorrectamente, GPT puede ser utilizado para generar contenido malicioso, como spam o phishing.

ChatGPT tiene una habilidad para codificar que ha sido aprovechada por criminales. Esta herramienta puede adaptarse a diversos lenguajes de programación y generar fragmentos de código que pueden ser utilizados en todo tipo aplicaciones. Como resultado, personas sin conocimientos en programación pueden crear código malicioso sin necesidad de aprender a codificar. No solo hablamos de pishing, sino también de la aplicación de estos sistemas para generar malware y hacer deepfake.

Ya lo sabes, más allá del futuro apocalíptico que muchas personalidades tech están profetizando (y que puede ser cierto), existen riesgos que estos sistemas pueden tener hoy para nuestro trabajo y seguridad en Internet.

Si te ha gustado este artículo, te invitamos a disfrutar demás contenido como este en nuestra sección de tecnología.

SEO estratega y redactor de contenidos especializado en temas de tecnología. Experto en crear estrategias de contenido que comunican complejidad técnica de forma clara y accesible.